Technologia przetwarzania języka naturalnego (NLP) streszcza i indeksuje dokumenty, pomaga w obsłudze klientów oraz precyzyjnie odczytuje ich zakupowe preferencje. Bogactwo zastosowań czyni ją technologią użyteczną w wielu branżach: od e-commerce, przez medycynę po marketing i reklamę.

Przetwarzanie języka naturalnego (NLP) - czym jest?

NLP (ang. Natural Language Processing), czyli przetwarzanie języka naturalnego, jest dziedziną sztucznej inteligencji (AI), która umożliwia komputerom:

- rozumienie języka naturalnego (NLU)

- generowanie tekstów w języku naturalnym (NLG)

NLP stosuje się m.in. w Siri oraz chatbotach, które automatycznie odpowiadają na pytania użytkowników, pełniąc funkcję wirtualnych asystentów. Do najbardziej popularnych modeli NLP należą: STM, GRU, BERT i GPT.

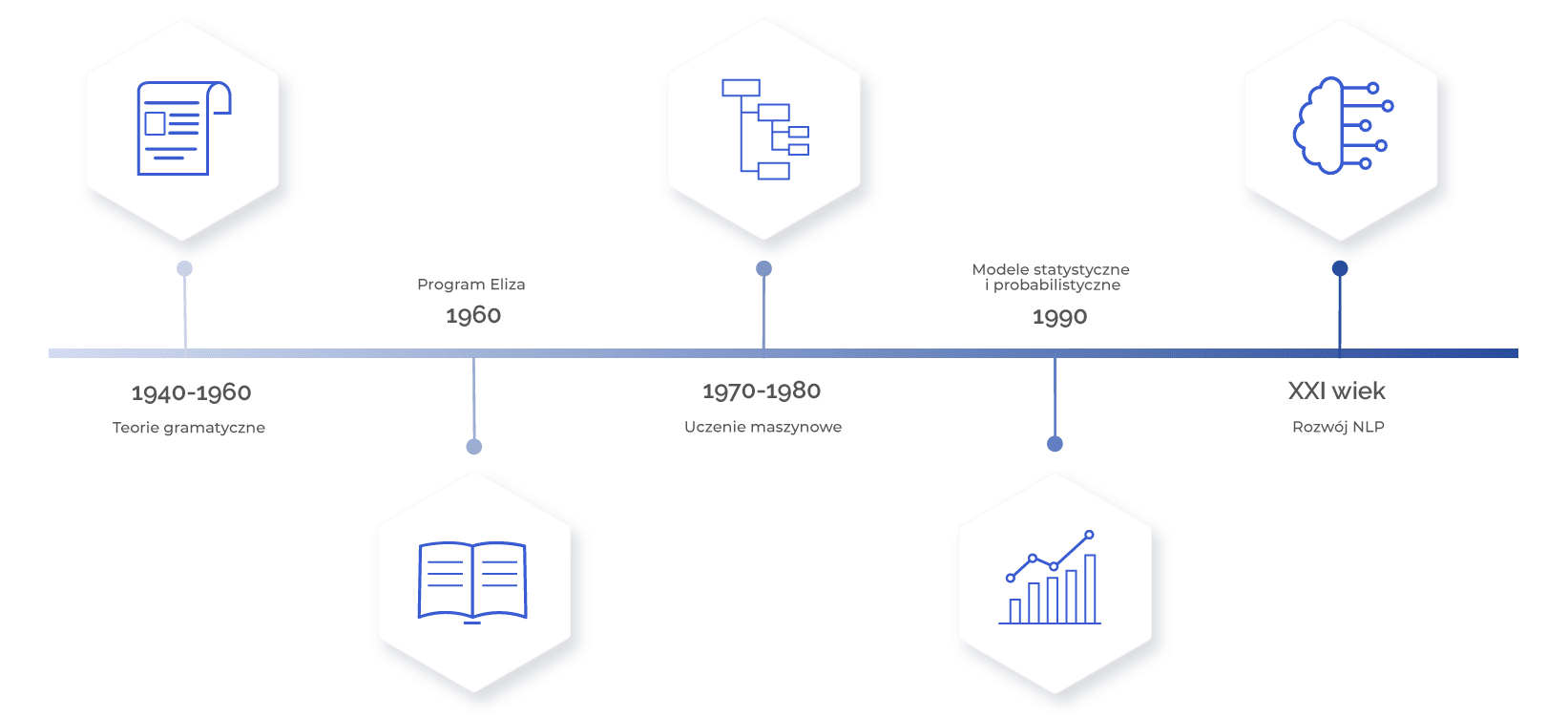

Historia NLP w pigułce

Historia przetwarzania języka naturalnego sięga lat 40. XX wieku. W kolejnych dekadach algorytmy NLP stawały się coraz bardziej zaawansowane. Obecnie ich podstawą są wielowarstwowe modele językowe, uczenie maszynowe i głębokie (ang. Machine Learning/Deep Learning) oraz sieci neuronowe.

Prześledźmy poszczególne etapy rozwoju NLP:

- 1940-1960: inżynierowie stawiają pierwsze kroki w dziedzinie informatyki i sztucznej inteligencji. Powstają proste systemy napędzane ręcznie tworzonymi regułami, które uwzględniają zasady gramatyk formalnych.

- 1960: Joseph Weizenbaum tworzy program Eliza – prosty chatbot symulujący rozmowę z psychoterapeutą. Jest to pionierski przykład interakcji człowiek-komputer.

- 1970-1980: wzrost mocy obliczeniowej procesorów umożliwił wprowadzenie algorytmów uczenia maszynowego (ang. machine learning).

- 1990: wprowadzono modele statystyczne i probabilistyczne (n-gramowe), uwzględniające duże korpusy językowe. Innowacje umożliwiły programom jeszcze lepsze odczytywanie teksów stworzonych w języku naturalnym.

- XXI wiek: dalszy dynamiczny rozwój NLP napędzany przez sieci neuronowe i postęp w dziedzinie sztucznej inteligencji (AI) – technologie symulujące złożoność funkcji poznawczych ludzkiego mózgu.

Jak działa przetwarzanie języka naturalnego?

Dzięki nowoczesnym technikom współczesne programy do przetwarzania języka naturalnego odczytują pełny sens komunikatu i generują treści przypominające te napisane przez ludzi. Cały proces dzieli się na kilka etapów:

- Tokenizacja: polega na rozbijaniu tekstu na tokeny, czyli mniejsze jednostki, zazwyczaj morfemy (zarówno rdzenne, jak i fleksyjne oraz słowotwórcze). Na przykład zdanie Lubię programowanie złożone z dwóch słów ma 4 tokeny: lubi – , – ę, program – oraz – owanie.

- Model worka słów: (ang. bag of words): mechanizm analizuje frekwencję słów, ignorując ich kolejność. Tak więc zdania złożone z tych samych wyrazów, ale występujących w różnej kolejności, traktuje tak samo. Odczytaniem sensu zajmuje się na kolejnych etapach. Przyspiesza to analizę słów w dużych zbiorach danych tekstowych.

- Usuwanie słów z tzw. stop-listy: polega na usuwaniu spójników (np. i, lub, ale), przyimków (np. w, na, do) czy partykuł (np. nie) ocenianych przez algorytmy, jako jednostki o niskiej wartości informacyjnej. Dzięki temu programy szybciej wykrywają kluczowe wyrazy wypowiedzi.

- Stemmatyzacja i lematyzacja: stemmatyzacja skraca słowa np. „biegnę”, „biegła” → „bieg”, ale bez zachowania poprawności językowej. Z kolei lemmatyzacja (lema- hasło) uwzględnia reguły gramatyczne i zwraca słownikową (kanoniczną) formę leksemu (np. „biegnę”, „biegła” → „biec”). Techniki pomagają rozpoznawać wyrazy o różnych końcówkach fleksyjnych/słowotwórczych.

- Znakowanie i analiza składniowa: dzięki identyfikacji końcówek fleksyjnych i słowotwórczych mechanizm określa funkcję poszczególnych słów w zdaniu. Zaczyna od parsowania (ang. post tagging), czyli wykrywania części zdania (podmiot, orzeczenie, przydawka, dopełnienie, okoliczniki) oraz relacji, jaka między nimi zachodzi. System tworzy w tym celu drzewo syntaktyczne. Następnie algorytm określa kategorie gramatyczne użytych wyrazów: rzeczownik, czasownik, przymiotnik itd.

- NER – rozpoznawanie nazw: algorytm szuka w wypowiedziach kluczowych danych: zdarzenia, fakty, liczby, jednostki czasu itd. Wyszukuje też nazwy własne, oddzielając je od słów o ogólnym znaczeniu. Na końcu identyfikuje przedmioty i podmioty wypowiedzi oraz dzieli tekst na klastry tematyczne (wątki).

- Analiza sentymentu: określa barwę emocjonalną komunikatu (pozytywne, negatywne, neutralne). Następnie do każdego słowa przypisuje tzw. wektory liczbowe (np. – < 1.0, 3.1, 4.2>-), które reprezentują zakodowaną w tekście informacje. Dzięki temu algorytmy szybciej analizują i porównują treści oraz wykrywają zależności między poszczególnymi częściami wypowiedzi.

Przetwarzanie języka naturalnego w akcji

Technologia NLP jest szeroko stosowana w różnych obszarach. W praktyce przetwarzanie języka naturalnego wspiera m.in.: proces analizy dużych ilości danych, obsługę klienta czy tłumaczenia maszynowe. Automatyzuje też operacje administracyjne. Poniżej kilka konkretów.

Obsługa klienta i centra kontaktowe

Algorytmy NLP implementuje się w chatbotach i wirtualnych asystentach używanych do obsługi klienta. Narzędzia automatycznie odpowiadają na pytania internautów. Istotną rolę odgrywa tu analiza sentymentu NLP, która rozróżnia ton emocjonalny wypowiedzi i umożliwia maszynom udzielanie adekwatnych informacji.

Marketing i reklama

Kolejnym obszarem zastosowania NLP jest reklama i marketing. Algorytmy m.in. masowo analizują treści publikowane na forach czy w mediach społecznościowych, dostarczając informacji o poziomie satysfakcji konsumentów. Marketerzy używają NLP również do optymalizacji kampanii reklamowych oraz generowania materiałów video, audio, tekstowych.

Opieka zdrowotna

NLP stosuje się również do analizy dokumentacji medycznej (historia choroby, orzeczenia zalecenia, informacje o diagnostyce itp.). Technologia streszcza treść i sortuje kluczowe wątki oraz tematy, np. przebieg hospitalizacji oraz informacje o przejęciu i wypisaniu pacjenta itp. Pomaga to personelowi szybko wdrożyć się w przypadek i poznać kluczowe dla diagnozy informacje. Z kolei funkcja rozpoznawania mowy wspiera personel w prostych czynnościach administracyjnych, m.in. rejestrowaniu pacjentów.

E-commerce i handel nowoczesny

NLP jest szeroko stosowany w e-commerce. Wspiera m.in. pracę sklepowych wyszukiwarek, generując trafniejsze wyniki oraz przyspiesza indeksację dużych ilości asortymentu. W tym celu analizuje opisy produktów, wyłuskując z nich potrzebne informacje, m.in.: cena, ilość, kolor, rozmiar itd. NLP może również przetwarzać historię zakupów klienta i poznawać ich preferencje na podstawie najczęściej pojawiających się w zamówieniach cech.

Tłumaczenia maszynowe

Automatyczne tłumaczenie tekstów z języka źródłowego na język docelowy jest pomocne w wielu branżach. Od medycyny, przez naukę po handel nowoczesny. Modele językowe (np. DeepL czy Google Translate) tłumaczą pojedyncze słowa, całe zdania a nawet złożone komunikaty. Przekładają artykuły, orzeczenia, ekspertyzy, umowy i inne ważne dokumenty. W transkrypcji stosuje się też technologie Speech to Text, aby przekładać mowę na tekst pisany w czasie rzeczywistym.

Jakie korzyści zapewnia NLP?

Przetwarzanie języka naturalnego zapewnia wiele korzyści:

- Oszczędność czasu

- Redukcja kosztów

- Wzrost efektywności pracy

Wyzwania i przyszłość NLP

Mimo że naturalne przetwarzanie języka rozwija się dynamicznie, wciąż pozostają obszary wymagające usprawnienia:

Rozumienie wieloznacznych słów i zdań

Na znaczenie słów wpływa kontekst. Widać to wyraźnie na przykładzie wyrazu „redakcja”, który czasami oznacza zespół zajmujący się tworzeniem treści w mediach (oraz miejsce), innym razem proces poprawiania i edytowania tekstu. Ta wieloznaczność dotyczy również zdań i wciąż stanowi wyzwanie dla modeli językowych NLP, zwłaszcza podczas analizy języków niszowych.

Uchwycenie kontekstu kulturowego

Wyrażenia i związki frazeologiczne odzwierciedlają tradycje oraz obyczaje danej społeczności. Wiele powiedzeń jest zrozumiałych jedynie dla osób znających warunki historyczno-kulturowe, w jakich język się rozwijał. Takich zdolności poznawczych nie mają obecnie nawet neuronowe modele złożone z kilku warstw operacyjnych.

Analiza intencji odbiorcy

Aby prawidłowo interpretować wypowiedź, trzeba określić również stosunek nadawcy do odbiorcy oraz sytuację i kontekst komunikacyjny. Na przykład ironia wymaga nie tylko dostrzeżenia barwy emocjonalnej słów, ale również relacji między rozmówcami (słowo kocham używane na określenie obowiązków, których nadawca nie lubi, niekoniecznie oznacza miłość). To tzw. pragmatyka językowa, która dla NLP wciąż jest wyzwaniem, ponieważ wymaga oceny treści na szerszym, pozajęzykowym tle. Między innymi z tego powodu NLP radzi sobie lepiej ze sformalizowanymi tekstami prawno-urzędniczymi, niż np. luźnymi postami na forach czy social mediach.

Opracowanie modeli językowych zdolnych do głębokiej analizy intencji wciąż pozostaje w sferze intensywnych badań.

Etyka

Przetwarzanie języka naturalnego nasuwa wątpliwości etyczne. Dane przeznaczone do trenowania modeli językowych mogą być obciążone uprzedzeniami lub błędami. W efekcie output może zawierać treści wykluczające określone grupy (społeczne, etniczne itp.) lub niezweryfikowane informacje. Poza tym algorytmy AI czasami kopiują styl określonych autorów bez ich zgody. Otwartym pytaniem pozostaje, kto ponosi za to odpowiedzialność – człowiek czy maszyna?

Kontrowersje budzi też wpływ technologii NLP i sztucznej inteligencji na rynek pracy. Czy algorytmy zabiorą ludziom pracę? Wizja technologicznego bezrobocia zderza się z twardą rzeczywistością i… przegrywa! Jak do tej pory badania wyraźnie mówią, że AI nie zabiera, ale upraszcza obowiązki, odciążając ludzi. Po drugie jest podglebiem, na którym rozwijają się kolejne zawody przyszłości, m.in.: reasercher AI, inżynier AI czy etyk ds. AI i nowych technologii.